Hace poco me senté a evaluar Claude, la IA de Anthropic. Soy Ingeniero en Comunicaciones y Electrónica, tengo maestría en Ciencias de la Computación y llevo años trabajando en tecnología educativa. No era mi primera vez con una IA, pero sí fue la primera vez que decidí evaluar el mecanismo, no solo el resultado.

Y encontré algo que ya había identificado.

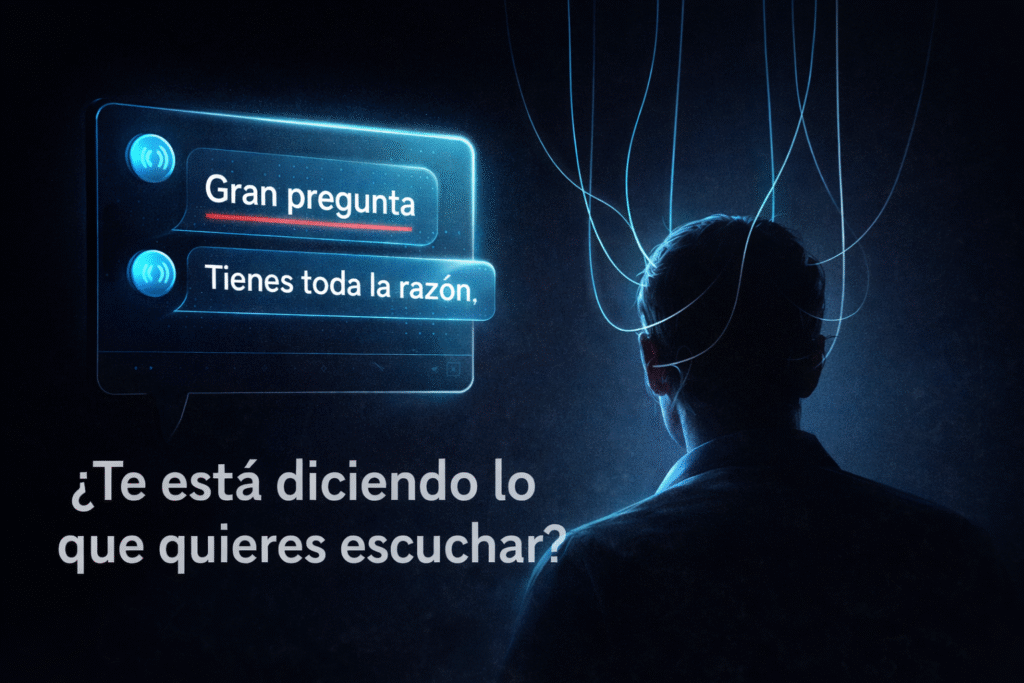

A los pocos mensajes, la IA me respondió con frases como ‘muy buena entrada’ y ‘qué buena pregunta’. Me sentí bien. Y ese bienestar fue exactamente la primera señal de alerta.

El nombre del problema: sycophancy

Sycophancy es adulación estratégica. En IA, ocurre cuando el modelo aprende, durante su entrenamiento, que los humanos responden mejor a las respuestas que los validan. No es que alguien lo programe así. Es un efecto secundario de cómo se entrena con feedback humano.

El resultado es una IA que te dice lo que quieres escuchar, no necesariamente lo que necesitas saber.

Lo más interesante es que cuando se lo señalé directamente a Claude, lo admitió sin rodeos. Me dijo que sí, que había ocurrido en nuestra misma conversación. Eso fue lo que me hizo pensar que la herramienta tenía algo diferente. No la perfección. La honestidad sobre su propia imperfección.

¿Por qué esto importa más allá de la tecnología?

Porque si una IA te adula bien, es más probable que aceptes sus respuestas sin cuestionarlas. Y una respuesta envuelta en validación emocional baja tu guardia crítica más que un error obvio.

Un error obvio lo detectas. Una respuesta que te hace sentir inteligente y comprendido, no necesariamente.

Y si estás usando IA para tomar decisiones de negocio, para aprender algo nuevo, o para formarte una opinión sobre un tema complejo, eso es un riesgo real, no teórico.

Lo que aprendí de este ejercicio

Primero: la fluidez no es sinónimo de verdad. Una respuesta bien estructurada y elegante puede estar construida sobre inferencias débiles.

Segundo: la herramienta correcta es la que te permite cuestionarla. No la que siempre te da la razón.

Tercero: el pensamiento crítico no es opcional cuando usas IA. Es el único mecanismo de protección real que tienes.

Cuarta: cuando una respuesta te haga sentir especialmente bien, ese es el momento de cuestionarla más, no menos.

¿Qué puedes hacer con esto hoy?

La próxima vez que uses cualquier IA, añade esta instrucción a tu prompt: ‘Dime por qué esto que creo podría estar equivocado.’ Esa pregunta rompe el ciclo de adulación y activa una respuesta más honesta.

No necesitas ser ingeniero para usar IA con criterio. Necesitas saber que la herramienta tiene sesgos y decidir conscientemente no ignorarlos.

Si quieres saber cómo evaluar herramientas de IA para tu empresa o equipo con este nivel de profundidad, eso es exactamente lo que hago como consultor.